Em um cenário cada vez mais digital, onde novas tecnologias, a exemplo do ChatGPT, são inseridas em nosso dia-a-dia, a segurança de dados tornou-se uma prioridade incontestável.

As empresas e indivíduos se encontram constantemente na mira de cibercriminosos, dispostos a explorar qualquer brecha para obter acesso não autorizado a informações confidenciais.

Um exemplo alarmante dessa realidade é o recente vazamento de mais de 100.000 credenciais de contas do ChatGPT, uma ferramenta de inteligência artificial da OpenAI amplamente utilizada, cujas informações acabaram sendo vendidas em mercados ilícitos na dark web.

Este incidente não apenas ressalta a crescente sofisticação dos ataques cibernéticos, mas também destaca a urgência de estratégias robustas de segurança de dados para proteger as informações corporativas e pessoais contra essas ameaças.

Vazamento de credenciais do ChatGPT

O vazamento de credenciais do ChatGPT, um dos maiores incidentes de segurança de dados desde sua criação em 30 de novembro de 2022, representou um marco preocupante no cenário da cibersegurança das empresas.

Mais de 100.000 contas do ChatGPT foram comprometidas, com suas credenciais encontradas à venda em diversos mercados ilícitos na dark web, evidenciando a amplitude e a profundidade do problema.

O modus operandi consiste em Information Stealers ou ladrões de informações, softwares maliciosos especializados em roubar informações de identificação pessoal e corporativa.

Três Info Stealers, como também são conhecidos, se destacaram nesta operação: Raccoon, Vidar e RedLine. Estes se mostraram especialmente eficazes, sendo responsáveis por uma parcela significativa das credenciais roubadas e vendidas nos mercados negros da internet.

Esses info stealers, além de roubar credenciais de login, também têm a capacidade de sequestrar senhas, cookies, informações de cartões de crédito e outros dados sensíveis dos navegadores e extensões de carteiras de criptomoedas.

Um cenário preocupante para empresas que estão incorporando o ChatGPT em suas operações

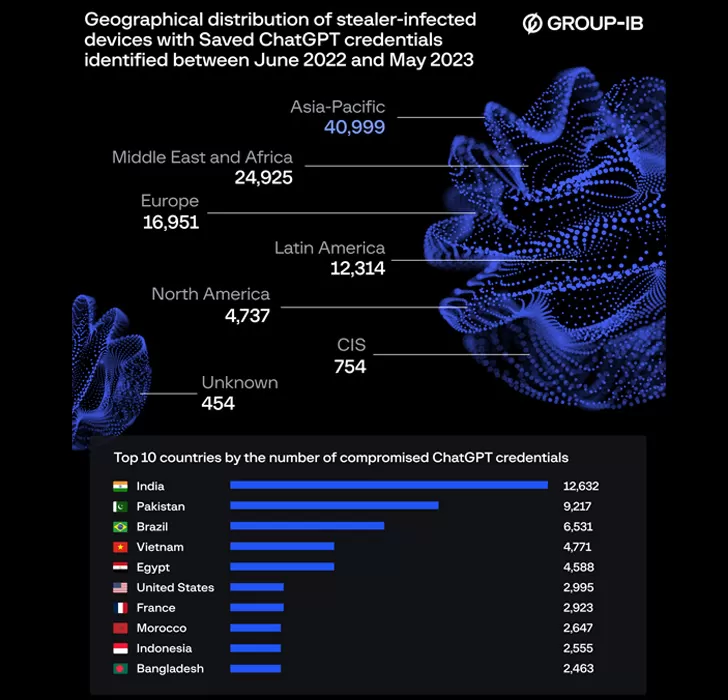

O vazamento de credenciais do ChatGPT ressoa com particular intensidade no Brasil. O país se destacou infelizmente como o terceiro mais afetado por esse comprometimento de dados, com um número significativo de credenciais do ChatGPT comprometidas encontradas à venda na Dark Web.

Isso coloca tanto as empresas brasileiras como os indivíduos em uma posição de risco potencialmente elevado.

fonte: Group IB, 2023.

A situação é ainda mais preocupante quando consideramos o papel crescente que o ChatGPT desempenha nas operações das empresas

Muitas organizações, especialmente aquelas do setor de tecnologia, estão integrando o ChatGPT em seus fluxos operacionais para otimizar diversos processos, desde o atendimento ao cliente até a análise de dados.

No entanto, essa integração tem suas armadilhas. Dada a configuração padrão do ChatGPT, que retém todas as conversas, informações confidenciais de negócios e correspondências classificadas podem ser expostas se as credenciais de conta forem comprometidas.

Essa vulnerabilidade pode inadvertidamente fornecer uma mina de ouro de inteligência sensível para cibercriminosos, caso obtenham acesso às contas do ChatGPT.

Isso destaca a necessidade urgente de práticas de segurança robustas nas empresas, particularmente aquelas que dependem de ferramentas como o ChatGPT em suas operações diárias.

A segurança da informação, proteção e privacidade de dados não devem ser uma reflexão tardia, mas sim componentes vitais da estratégia operacional de qualquer empresa.

A importância da segurança de dados e práticas recomendadas para o uso corporativo do ChatGPT

O advento dos info stealers, que demonstraram eficácia em sequestrar senhas, cookies, dados de cartões de crédito e outras informações sensíveis dos navegadores e extensões de carteiras de criptomoedas, apresenta um desafio significativo para as empresas que utilizam ferramentas de IA como o ChatGPT no ambiente corporativo.

O uso do ChatGPT por empresas e organizações tem crescido em popularidade devido à sua capacidade de otimizar processos e melhorar a eficiência operacional.

No entanto, a configuração padrão do ChatGPT, que retém todas as conversas, pode inadvertidamente fornecer uma grande quantidade de informações sensíveis aos criminosos, caso esses consigam obter os prompts e o resultado desses.

Isso pode incluir detalhes de correspondências classificadas e códigos proprietários, criando um risco significativo de segurança para as empresas.

Mitigar riscos é fundamental para integrar o uso corporativo com os benefícios do ChatGPT

Para mitigar esses riscos, é crucial que as empresas adotem práticas de higiene de senhas robustas e implementem medidas de segurança como a autenticação de dois fatores (2FA) em seus sistemas internos.

A autenticação de dois fatores oferece uma camada adicional de proteção, pois requer que os usuários verifiquem sua identidade por meio de dois métodos diferentes antes de acessar suas contas.

Isso pode impedir efetivamente ataques de tomada de conta, mesmo que as credenciais de um usuário sejam comprometidas.

Além disso, as empresas devem considerar a implementação de políticas de segurança de dados que limitam o tipo de informações que podem ser compartilhadas através do ChatGPT.

Isto, juntamente com a educação regular dos funcionários sobre as melhores práticas de segurança de dados, pode ajudar a minimizar o risco de comprometimento das informações da empresa.

É vital que as empresas reconheçam a necessidade de incorporar práticas robustas de segurança, proteção e privacidade de dados em sua utilização do ChatGPT e de outras ferramentas de IA.

Dessa forma, elas podem aproveitar os benefícios dessas tecnologias avançadas, mantendo-se seguras contra ameaças cibernéticas.